狼?ハスキー犬?「説明可能なAI」に判断基準を問い詰めてみたら

AIの急速な普及に伴って、何を根拠にどう判断したのか?を説明する、XAI(説明可能なAI)の重要性にフォーカスが当たっています。

前回の記事では、XAIの基本概念と、医療・金融・製造業などでの活用事例を紹介しました。今回は、そのXAIが実際にどのような技術で実現されているのか、LIMEやSHAPといった代表的な手法と、興味深い実験例を通じて詳しく見ていきましょう。

XAIの代表的な手法

XAIを実現する手法はいくつか存在しますが、ここでは代表的な2つの例を紹介します。

LIME(Local Interpretable Model-Agnostic Explanations)

LIMEは、AIモデルが出力した結果に対し、局所的な領域での解釈を可能にする手法です。

LIMEの特徴

- 局所的解釈:一つ一つの予測について、その周辺での振る舞いを説明

- モデル非依存:どんなAIモデルにも適用可能

- シンプルな代理モデル:複雑なAIの動作を、理解しやすいモデルで表示

LIMEは、特定の予測に焦点を当て、その予測の周辺で特徴を少し変化させながらAIの反応を観察します。そして、その観察結果から、人間が理解しやすい線形モデルなどのシンプルなモデルを作成し、「この予測においては、この特徴が重要だった」という説明を提供します。

SHAP(SHapley Additive exPlanations)

SHAPは、ゲーム理論のシャプレイ値という概念をベースにした手法です。

SHAPの特徴

- 公平な貢献度計算:各特徴量がどれだけ予測に貢献したかを、公平に計算

- 局所と大域の両方に対応:個別の予測だけでなく、モデル全体も説明可能

- 理論的基盤:ゲーム理論に基づく確固たる数学的基盤

SHAPは、各特徴量を「プレーヤー」と見なし、予測結果を「報酬」と考えます。そして、全ての特徴量の組み合わせを考慮しながら、各特徴量が予測にどれだけ貢献したかを計算します。これにより、「なぜこの予測になったのか」を定量的に示せます。

その他の手法

上記以外にも、以下のような手法があります。

- Attention機構の可視化:ニューラルネットワークが「どこに注目したか」を可視化

- 決定木の活用:データを階層的に分類する、視覚的に理解しやすいアルゴリズム

- 反実仮想説明:「もしこの特徴が違っていたら、結果はどう変わったか」を示す

オオカミとハスキー犬の分類実験

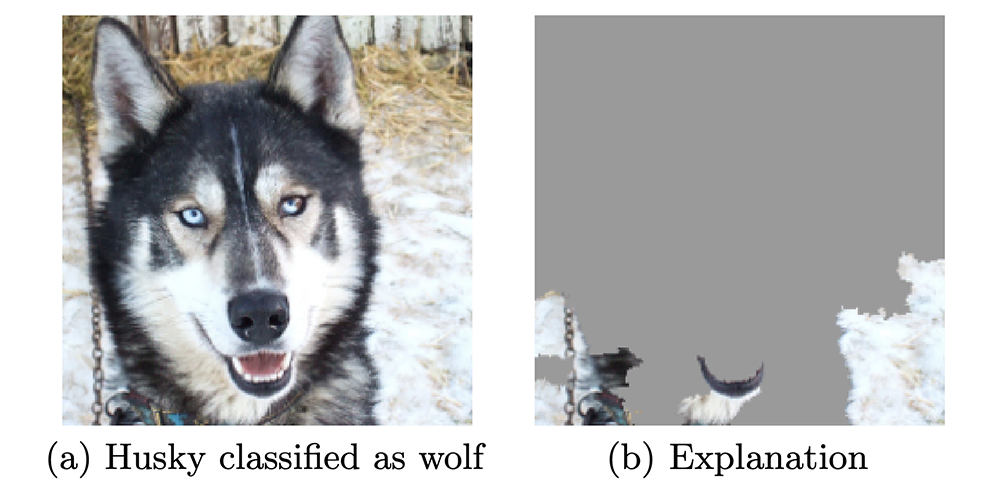

では、実際にXAIはどのような処理をして判断を下すのでしょうか?以下の論文で紹介された、LIMEを使ってAIの誤った分類結果を可視化する実験を紹介しましょう。

▼[1602.04938] Marco Tulio Ribeiro, Sameer Singh, Carlos Guestrin, “Why Should I Trust You?”: Explaining the Predictions of Any Classifier

https://arxiv.org/abs/1602.04938

実験内容

論文の筆者らは、非常によく似ているオオカミとハスキー犬の分類の誤りについて、被験者が正しく洞察できるかを調査しました。この実験では、LIMEを用いてAIが注目した特徴を可視化し、被験者に提示しました。

- オオカミとハスキー犬を分類するAIモデルを用意

- オオカミの画像には雪の背景が多く含まれる一方で、ハスキー犬には雪の背景がない画像を選択

- AIモデルにこれらを学習させ、分類を実施

- AIは雪があるかどうかを基準に分類するようになり、誤った判断を下してしまう

この実験でAIは、動物の色や位置、ポーズではなく、「雪があるかどうか」を基準に分類するようになってしまいました。つまり、本来見るべき動物の特徴ではなく、背景の雪に注目してしまったのです。

この不適切なAIモデルを意図的に訓練し、被験者がそれを検出できるか評価しました。実験では、最初に分類結果(図4(a))を提示し、その後、被験者に次の3つの質問をしました。

- このアルゴリズムが実世界でうまく機能することを信頼するか?

- 信頼する理由は?

- このアルゴリズムが、狼とハスキー犬の写真をどのように区別していると思うか?

その後、説明付きの画像(図4(b))を示して同じ質問をしました。

この被験者は大学院生で、機械学習コースを受講した経験があります。評価者は、被験者の質問(3)で、「モデルが、雪や背景を分類の条件に使用していること示しているか?」どうかを判断しました。説明を見た後では、被験者のほぼ全員が正しい洞察を特定し、分類器に対する信頼度が大幅に低下しました。

研究や実証実験が進むことで、AIの知識がない人にも分かりやすい根拠を示すXAIが登場することが期待できます。

実験結果の要点

- 説明なしの状態では、被験者はAIを信頼する傾向が強かった

- LIMEによる説明を見た後、被験者のほとんどがAIの誤りを理解し、信頼度が低下した

出典:[1602.04938] Marco Tulio Ribeiro, Sameer Singh, Carlos Guestrin, “Why Should I Trust You?”: Explaining the Predictions of Any Classifier

https://arxiv.org/abs/1602.04938

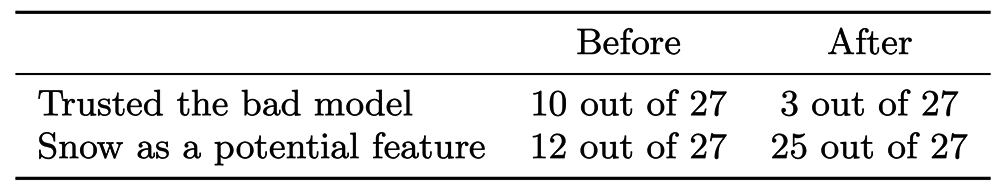

1行目-質問(1)の結果⇒根拠となる画像を見る前と後で、AIモデルの信頼度が大幅に低下している。

2行目-質問(3)の結果⇒根拠となる画像を見ることで、ほとんどの人が、AIモデルが雪や背景を分類の条件に使用していることを洞察できている。

出典:[1602.04938] Marco Tulio Ribeiro, Sameer Singh, Carlos Guestrin, “Why Should I Trust You?”: Explaining the Predictions of Any Classifier

https://arxiv.org/abs/1602.04938

XAI技術の課題と今後の展望

オオカミとハスキー犬の実験が示すように、XAIは非常に有用な技術ですが、いくつかの課題も残されています。

計算コストの問題

SHAPなどの手法は、全ての特徴量の組み合わせを考慮するため、計算コストが高くなります。特に、ChatGPTのような大規模言語モデル(LLM)やリアルタイム処理が必要な場面では、パフォーマンスとのトレードオフを考える必要があります。

説明の複雑性

LIMEやSHAPの出力は、専門家には理解できても、一般のユーザーには難しい場合があります。技術的な説明を、どのように分かりやすく伝えるかが重要な課題です。

完全性の限界

XAIは「なぜそう判断したか」の近似的な説明を提供しますが、AIの内部動作を100%正確に表現しているわけではありません。特に深層学習のような複雑なモデルでは、完全な説明は困難です。

今後の方向性

こうした課題に対して、研究は日々進んでいます。より効率的なアルゴリズムの開発、LLMに対応したXAI技術、誰にでもわかる説明方法が活発に研究されています。

XAI技術の進化により、AIはより信頼され、社会に広く受け入れられる存在になっていくでしょう。

「AIが何を考えているか」を理解することの重要性

説明可能なAI(XAI)は、AIの判断過程を可視化し、透明性を高める重要な技術です。LIMEやSHAPといった手法により、これまでブラックボックスだったAIの内部を、私たちは少しずつ理解できるようになってきました。

オオカミとハスキー犬の実験が示すように、XAIは単にAIの精度を高めるだけでなく、AIの誤りを発見し、改善するためにも不可欠です。医療診断や金融審査、製造業など、説明責任が求められる分野では、今後ますますXAIの重要性が高まるでしょう。

AIの社会実装が進む中で、「AIが何を考えているか」を理解することは、AIを信頼し、適切に活用するための第一歩です。

変化が激しく予測困難な時代の中で、新しい技術を自社のビジネスに取り込んでいくには、柔軟で変化に強いシステム開発環境を確立することが不可欠です。

BlueMemeには、ローコード・ノーコードやアジャイル開発の活用において、失敗も含む豊富な現場経験があります。ぜひ、私たちのノウハウを御社の戦略にお役立てください。