量子コンピューターとAI:ニューラルネットワークやLLMとの関係

この記事では、量子機械学習を専門分野とする筆者が、一般の人が今一番気になっていると思われる「量子コンピューターとAI」についての疑問に答えていきます。最近話題のChatGPTに代表される生成AIの分野に関連して、「量子AI」という言葉もちらほら見かけるようになりました。『ChatGPTの開発にも、量子コンピューターは役立つの?』『そもそも、量子コンピューターの分野とAIの分野は関連しているの?』『量子AIって何?最新の研究トレンドを知りたい!』『将来のAIの技術発展を予測したい!』といった、皆さんが抱いている疑問にお答えします。

量子コンピューターとAIは、関連している?

量子コンピューターとAIは、深く関連しています。ChatGPTに代表されるような大規模なAIモデルは、その開発のためにコンピューターの巨大な計算パワーを必要としています。過去記事でも紹介しましたが、大規模AIモデルの学習には、AI開発用のGPUスーパーコンピューターを用いた超大規模の計算量が必要です。

その一方で、GPUをも凌駕する巨大な計算パワーを持つ量子コンピューターは、やはりAI開発への活用が期待されています。そのアイデアの本質は、量子コンピューターが持っている「重ね合わせ」の原理や、「量子もつれ(エンタングルメント)」といった量子コンピューター特有の情報処理効果が、 従来のAI開発で処理している計算と極めて相性がいい点にあります。

こうした前提を基にした研究分野が量子AIです。量子AIとは、量子コンピューターの特性を利用してAIの計算を処理する技術や、アルゴリズムに関する研究分野のことを指します。ChatGPTに代表されるような、深層学習・機械学習モデルの開発に量子コンピューターを応用する量子AIの中の一研究分野は、「量子機械学習」と呼ばれています。以下で、具体的に最新の研究事例を挙げながら、チェックしていきましょう。

最新の量子機械学習研究トレンド1. 量子回路学習

量子コンピューターを機械学習に応用した日本発の研究

量子回路学習は、2018年に大阪大学の研究グループである御手洗博士らによって初めて提唱されました。現在でも、この論文をベースとした量子機械学習の研究が数多く展開されています。

▼[Mitarai, Kosuke, et al. “Quantum circuit learning.” Physical Review A 98.3 (2018): 032309.][1803.00745] Quantum Circuit Learning

https://arxiv.org/abs/1803.00745

「訓練・学習」とは、パラメータの更新のこと

ChatGPTのニュースでもよく出てくる、大規模言語モデルの「学習」とか「訓練」という言葉の意味は、「関数を構築しているパラメータを更新する」ということです。深層学習や機械学習で処理しているのは、入出力間の関係を結ぶ大量のパラメータからなるより良い関数の探索です。この、パラメータセットを更新していきながら、より良い関数を構築するようなパラメータセットを見つけることを、「学習」や「訓練」といいます。

量子回路学習による、古典コンピューターを超えるモデルの表現力向上への期待

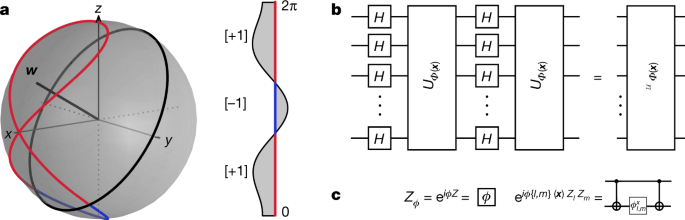

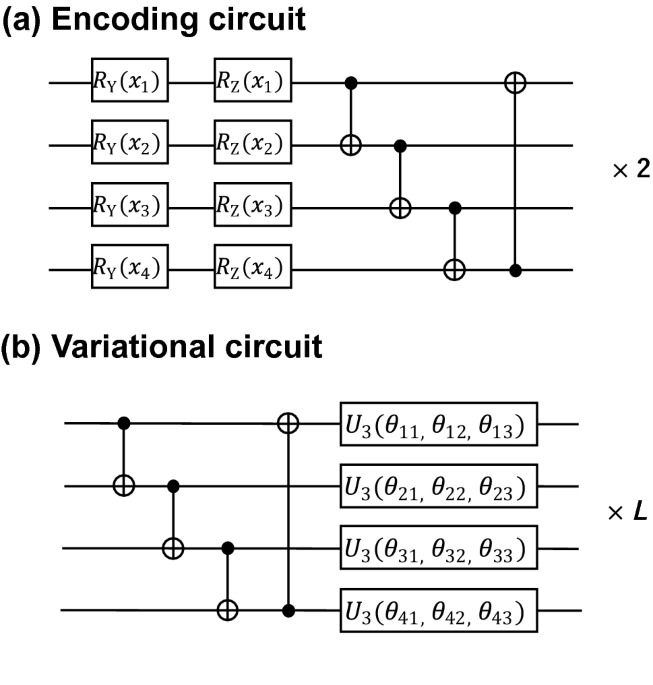

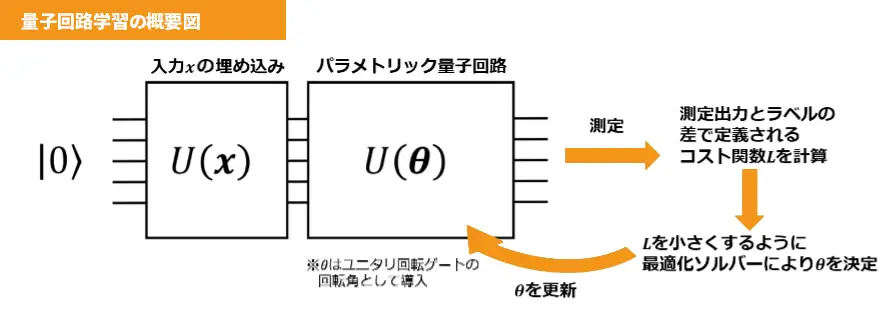

量子回路学習は、機械学習の文脈で出てくるパラメータの更新の概念を、量子コンピューターに直接模倣して提案されました。ニューラルネットワークの場合は、ニューロンが持つパラメータを微調整しながら学習していきます。これに対応して次の図のように量子回路学習の場合は、「回転ゲート」という、量子ビットをいろいろな角度に回転させるように操作するゲートの回転角度のところをパラメータとみなして微調整していきます。

量子回路学習のメリットは、古典コンピューター(現行のコンピューター)に比べてモデルの表現力が向上することです。過去記事でも紹介している、量子コンピューターにしかない特性である「重ね合わせ」や「量子もつれ」は、機械学習において、データの持つ複雑なパターンを捉える能力を向上させることが分かっています。「重ね合わせ」や「量子もつれ」については下記記事も参照してみてください。

盛んに実施されている、量子実機を用いた機械学習の実証実験

上記の理論は机上の空論ではなく、すでに量子コンピューター実機そのものでも、実証実験が頻繁に行われています。実際のNISQデバイスを用いた実験もすでに行われており、2019年3月にIBMの実験チームによる量子回路学習の実機実装論文が、科学雑誌Natureに掲載され話題となりました。

また、同様に日本でも材料計算のドメインにおいて、IONQというイオントラップ型の実機を使って、量子回路学習の実証実験が行われています。

IONQに関しては、次の記事でも紹介しているので、併せてお読みください。

最新の量子機械学習研究トレンド2. 大規模言語モデル開発

ChatGPTも作れる!?量子コンピュータが変える未来

ここまで読んで、『ChatGPTのような大規模言語モデルにも、量子コンピューターは使えるのではないか?』と思った方もいるかもしれません。まさにその通りで、量子計算により将来の大規模言語モデル開発は大きく変わっていくことが予想されます。

すでに論文も出ていて、今後も研究展開が予想される分野

2022年に提唱され、今年出版された論文Interpretable Quantum Advantage in Neural Sequence Learningによると、 古典コンピューターで訓練した言語モデルの性能を、量子コンピューターで訓練するモデルが凌駕する可能性を示唆しています。

この論文では、自然言語処理のタスクにおいて、古典的なニューラルネットワークよりも量子機械学習モデルが優れたパフォーマンスを出す、ということを理論と仮想的なシミュレーションから示しました。

どのようなアイデアで量子優位性を導いたか

ChatGPTなどの大規模言語モデルで画期的だったのは、内部にあるニューラルネットワークが文章の文脈を把握できることでした。Transformerと呼ばれる2017年のモデルがそれにあたります。

一方、量子言語モデルでは、どのようにTransformerのような古典モデルに対する優位性を示したかというと、量子文脈性というものを使っています。量子文脈性とは量子力学に固有の性質であり、「この性質を用いると、言語の意味理解や生成という文脈探索のタスクにおいて、古典的なモデルよりも優れた能力を発揮することができる」ことを理論的に示しています。

量子コンピューターを大規模言語モデルに応用するメリット

量子コンピューターを大規模言語モデルに応用するメリットは、2つあります。

一つは、パラメータ数の劇的な削減によって、モデルの開発の低減が期待できることです。論文によると、従来の古典コンピューター上で大規模言語モデルを1,000万〜1億程度の大量パラメータを使用して学習していたのを、量子コンピューターを使えば、少なくとも100万のスケールまで落とせるのではないか、と期待されています。

もう一つは、量子文脈性に基づいて、言語の意味理解や生成において古典的なモデルよりも優れた能力を発揮する可能性があることです。著者の見立てでは、量子コンピューター×大規模言語モデルはトレンドも相まって、今後一層、研究展開が激しくなると予想されます。

ますます目が離せない注目の領域!

今回は、意外とつなげて考えられることがなかった量子コンピューターとAIの関連について、最新研究事例も交えて説明しました。この領域は、今後ますます研究が加速することは間違いないので、随時情報をアップデートしていきます!ご期待ください。